数手指数晕了的 AI

前两天有人让 DeepSeek 数手指。它思考了一通,自己吐槽「我真的是数晕了」,然后答错了。

以为是灰度测试的小问题。但这篇论文告诉我们,数手指数晕这件事,背后藏着一个 GPT、Claude、Gemini 集体没解好的技术瓶颈。

看得清 vs 指得准

目前所有 AI 看图,本质上都是把图片转成文字来思考。

过去两年,OpenAI、Google、Anthropic 拼命做一件事:让 AI 看得更清楚。高分辨率裁切、动态分块、图片放大再塞进去。

DeepSeek 把这叫「感知鸿沟」——AI 看不清。但这篇论文指出了另一个瓶颈:「引用鸿沟」。

AI 看清了,但没法精确指向图里的某个东西。一张合照 25 个人密密麻麻站一起,用语言描述「左边第三排穿蓝色球衣旁边那个人」——描述本身就是模糊的。AI 数着数着就丢了上下文,忘了数到谁。

人类怎么解决?够原始的。伸出手指,指一个数一个。

给 284B 参数的模型装一根手指

DeepSeek 的方案就这么朴素:让 AI 在思考时直接在图上画框标坐标。

- 数人?每个人身上画一个框,数框就行

- 走迷宫?每走一步在图上标一个点,留下路径记录

两种格式:框(Bounding Box)和点(Point)。DeepSeek 管它们叫「视觉原语」——视觉推理中最小的思维单元。

关键区别:以前 AI 输出坐标是给最终答案,现在坐标嵌入了思考过程本身。不是答卷上的答案,是草稿纸上的标记。

7056 倍压缩,还能数清 25 个人

一张 756×756 的图,57 万像素,DeepSeek 一路压成 81 个信息单元。压缩比 7056 倍。

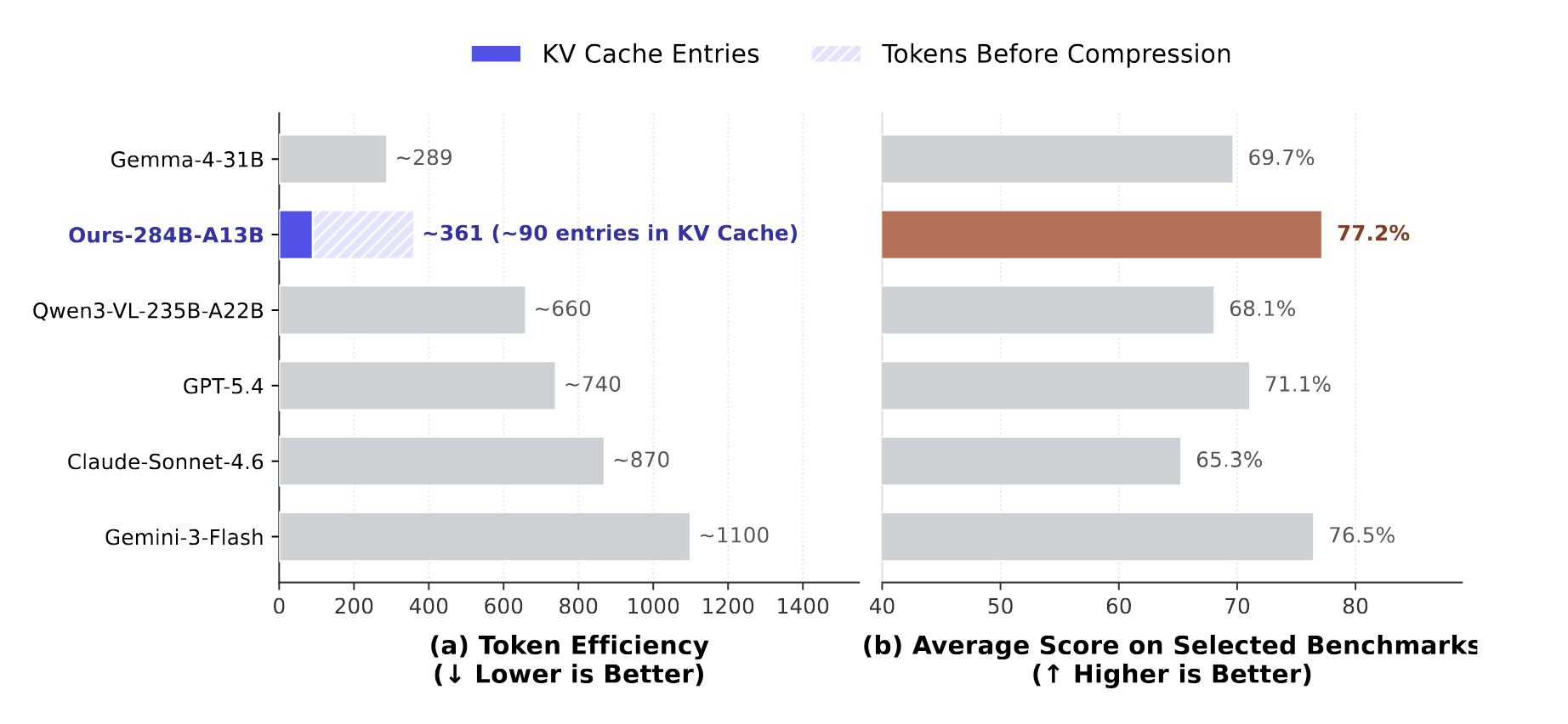

模型 | 每图 Token 数 |

Gemini-3-Flash | 约 1100 |

Claude-Sonnet-4.6 | 约 870 |

GPT-5.4 | 约 740 |

DeepSeek | 90 |

DeepSeek 用 90 个 Token 就搞定了。省下来的算力全拿去「指」。

别人在掷硬币,DeepSeek 在认真走

迷宫测试最能说明问题。迷宫只有两种答案:有路,或者没路。随机猜正好 50%。

模型 | 准确率 |

DeepSeek | 66.9% |

GPT-5.4 | 50.6% |

Claude-Sonnet-4.6 | 48.9% |

Gemini-3-Flash | 49.4% |

GPT、Claude、Gemini 全在 50% 附近晃。跟掷硬币没区别。DeepSeek 的 66.9% 不算完美,但它确实在一步步走,不是在蒙。

路径追踪更夸张:Claude 只有 30.6%,比瞎猜强一点。DeepSeek 是 56.7%。

4000 万条数据的筛选工程

DeepSeek 从 Huggingface 爬了 97,984 个数据源。

- 第一轮:砍掉标签无意义的、私人实体的、模糊缩写的。砍 56%

- 第二轮:砍掉漏标太多的、框画歪的、框太大的。再砍 27%

- 最终产出超过 4000 万条高质量样本

然后分头练:框的数据训练一个专家,点的数据训练另一个专家。分别做强化学习,最后合并。

DeepSeek:始终在「用更少做更多」

时间 | 模型 | 关键创新 |

2024.06 | V2 | MLA 压缩注意力机制 |

2024.12 | V3 | 671B 参数 MoE,278 万 GPU 小时训练 |

2025.01 | R1 | 纯强化学习激发涌现推理 |

2026.04 | V4 | 100 万 Token 上下文 + Engram 记忆 |

每一次,DeepSeek 都在做同一件事:用更少的算力做更多的事。

为什么要删?

- 技术太超前:视觉原语的效果远超预期,DeepSeek 可能不想让竞争对手这么快跟进

- 节奏问题:视觉模式还在灰度测试,论文可能超前于产品发布计划

- 内部流程:研究员个人在 X 上发布,可能没走完完整的内部审批

后续分析:视觉原语将如何改变行业

OpenAI/Anthropic 会在 6 个月内跟进

视觉原语的技术路径清晰且可复制,不依赖特殊硬件。GPT/Claude 在迷宫测试上的「掷硬币」表现说明纯语言推理在空间任务上已触及天花板。参照 DeepSeek-R1 发布后,OpenAI 在 3 个月内推出类似推理链产品的历史,视觉锚点机制被竞争对手跟进几乎是必然。

DeepSeek 可能在 V4.1 中正式集成

论文表明技术已进入强化学习优化阶段,4000 万条训练数据就绪,模型架构已验证。DeepSeek 历史上从论文到产品部署周期约 2-4 个月。但「删论文」行为暗示内部可能存在路线分歧,存在延迟风险。

这对普通用户意味着什么

当 AI 学会「指」,许多现在做不到的事将变得可能:看电路图自动定位故障点、医学影像精确标注病灶、自动驾驶理解复杂路口的空间关系。66.9% 只是起点。教模型伸手指这件事,才刚刚开始。

分辨率军备竞赛可以缓一缓了。多模态推理的下一步,不在更高的分辨率,不在更多的 token。而在让 AI 学会在图中定位、比较、追踪。

教模型伸出手指,比给它配一副更贵的眼镜管用。

这只鲸鱼开了眼之后,还长出了手指。

基于论文撤稿前全文分析 | 黑粉科技 · hyphentech.top

分享到: